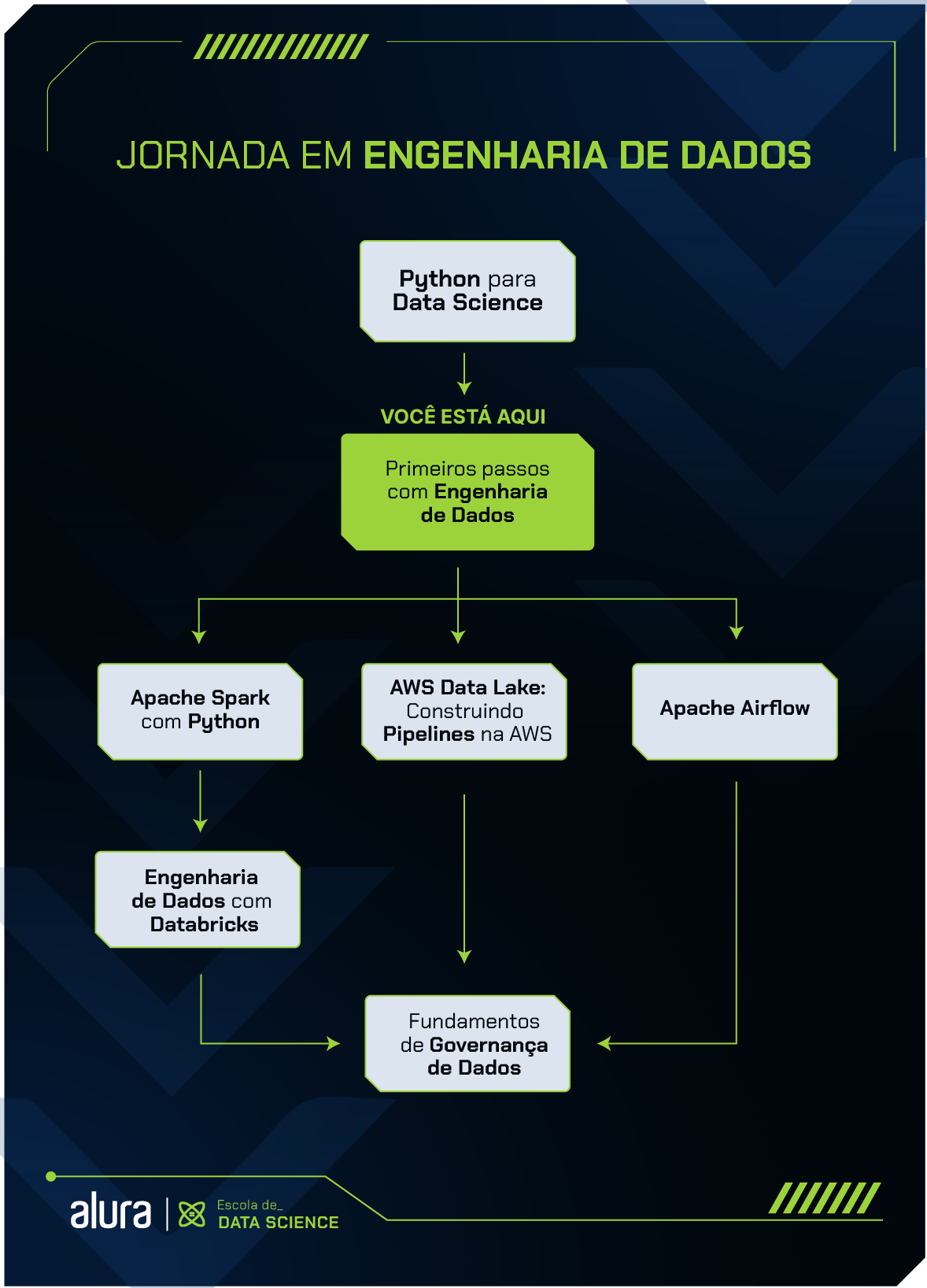

Formações Data Science Primeiros passos com Engenharia de Dados

Formação Primeiros passos com Engenharia de Dados

* Esta formação faz parte dos nossos cursos de Data Science

Quero Estudar na AluraAprenda a criar seu primeiro pipeline de extração, transformação e carregamento utilizando Python, fazer consultas e extrações de dados com SQL e criar seu primeiro pipeline com Airflow, se prepare para a área de Engenharia de Dados para os desafios do dia a dia profissional, usando Python, SQL, NoSQL e outras ferramentas.

Funciona como um guia de aprendizado para auxiliar pessoas interessadas em entrar no mercado de trabalho e também como mecanismo de consulta para profissionais experientes.

A Engenharia de Dados desempenha um papel crucial na indústria da tecnologia, permitindo que empresas de diversos setores coletem, armazenem, processem e analisem grandes volumes de dados em tempo real.

Profissionais especializados nessa área são responsáveis por projetar, implementar e manter a infraestrutura necessária para o gerenciamento eficiente dos dados de uma organização. Eles criam fluxos de dados que integram, limpam e transformam informações provenientes de diferentes fontes e formatos, possibilitando a geração de insights valiosos para a tomada de decisões empresariais.

Nesta formação, você terá a oportunidade de adquirir conhecimentos essenciais para ingressar na área de Engenharia de Dados. Exploraremos diversos tópicos fundamentais, como Python, SQL e pipelines de dados.

Iniciaremos aprendendo a construir pipelines ETL (Extract, Transform e Load) utilizando a linguagem Python, além de compreender como aplicar Programação Orientada a Objetos (POO) para tornar seus códigos mais legíveis.

Além disso, nesta formação, você terá a oportunidade de compreender a diferença entre bancos de dados SQL e NoSQL, assim como os principais conceitos relacionados a esses sistemas de armazenamento de dados.

Por fim, você consolidará todos os conhecimentos adquiridos ao longo dessa formação, desenvolvendo um pipeline completo de Engenharia de Dados. Você terá um primeiro contato com uma das ferramentas de gerenciamento de fluxos de dados, o Airflow. Essa experiência irá ampliar ainda mais suas habilidades e prepará-lo para enfrentar desafios reais na área de dados.

Para aproveitar melhor esse conteúdo, é importante que você já tenha conhecimento dos conceitos-chave do Python aplicados à área de Data Science de forma abrangente.

Conteúdos pensados para facilitar seu estudo

Formação completa para o mercado

Do zero ao sonhado emprego em sua área de interesse

Comece essa formação agora mesmo e capacite-se para seu próximo projeto!

Conheça os planosDanielle é formada em Sistemas de Informação. Fez parte do Scuba Team. Atualmente é instrutora de Data Science, nas áreas de Banco de dados, Business Intelligence e NoSQL. É apaixonada por livros, música e tecnologia.

Danielle é formada em Sistemas de Informação. Fez parte do Scuba Team. Atualmente é instrutora de Data Science, nas áreas de Banco de dados, Business Intelligence e NoSQL. É apaixonada por livros, música e tecnologia.

Millena Gená é estudante de Ciência da Computação. Atualmente, é Instrutora de Dados aqui na Alura atuando principalmente na área de Engenharia de dados. Ela está sempre procurando aprender algo novo sobre tecnologia e é apaixonada por novas aventuras. Programar e ajudar as pessoas são seus hobbies favoritos! ^^

Millena Gená é estudante de Ciência da Computação. Atualmente, é Instrutora de Dados aqui na Alura atuando principalmente na área de Engenharia de dados. Ela está sempre procurando aprender algo novo sobre tecnologia e é apaixonada por novas aventuras. Programar e ajudar as pessoas são seus hobbies favoritos! ^^

Sou graduado em Ciência da Computação. Atuo como instrutor de Data Science e Machine Learning no Grupo Alura, tendo como principais interesses na tecnologia: criação de modelos e análise de dados. Nas horas vagas assisto e analiso dados de basquete e adoro ouvir podcasts de humor como Nerdcast e Jujubacast.

Sou graduado em Ciência da Computação. Atuo como instrutor de Data Science e Machine Learning no Grupo Alura, tendo como principais interesses na tecnologia: criação de modelos e análise de dados. Nas horas vagas assisto e analiso dados de basquete e adoro ouvir podcasts de humor como Nerdcast e Jujubacast.

Sou bacharela em Estatística e atualmente curso Ciência da Computação. Já atuei como cientista de dados no ramo educacional e financeiro e hoje sou instrutora na Escola de Dados da Alura e voluntária na equipe de projetos do grupo Data Girls. Sou apaixonada por transformar dados em informação inteligente usando a ciência de dados em diversos tipos de aplicação. Fora isso, sempre estou acompanhando alguma série e procurando novas rotas para andar de bike.

Sou bacharela em Estatística e atualmente curso Ciência da Computação. Já atuei como cientista de dados no ramo educacional e financeiro e hoje sou instrutora na Escola de Dados da Alura e voluntária na equipe de projetos do grupo Data Girls. Sou apaixonada por transformar dados em informação inteligente usando a ciência de dados em diversos tipos de aplicação. Fora isso, sempre estou acompanhando alguma série e procurando novas rotas para andar de bike.

Neste passo inicial, o objetivo é que você se familiarize com a área da Engenharia de Dados, explorando o uso da linguagem Python em análise e gerenciamento de dados.

Curso Pipeline de dados: combinando Python e orientação a objeto

12hCurso Python e APIs: conhecendo a biblioteca Requests

08hVamos embarcar em uma jornada para aprender a modelar um banco de dados relacional utilizando SQL, usando o SGBD MySQL e suas principais cláusulas. Demonstraremos como criar esquemas e tabelas, definir chaves primárias e estrangeiras, além de realizar filtros, inserir e excluir informações, utilizar funções de agregação e explorar outros conceitos e técnicas essenciais.

Logo em seguida, introduziremos o MongoDB, um banco de dados orientado a documentos que armazena informações em formato JSON. Você aprenderá a importar dados de arquivos JSON, realizar buscas, atualizar registros e remover informações.

Curso Modelagem de banco de dados relacional: entendendo SQL

06hCurso MongoDB: conhecendo um banco de dados NoSQL

08hNeste terceiro passo, temos a intenção de orientá-lo na compreensão de um elemento crucial da Engenharia de Dados: o pipeline de dados. Este é um conceito essencial para o gerenciamento eficiente de dados em qualquer projeto de Ciência de Dados.

Nessa etapa, você construirá seu próprio pipeline de dados utilizando Python.

Curso Pipeline de dados: integrando Python com MongoDB e MySQL

08hNeste quarto passo, você mergulhará no mundo da orquestração de pipelines de dados, um componente fundamental na engenharia de dados. Aqui, o desafio será extrair dados climáticos usando uma API, empregando o Apache Airflow. Você não apenas aprenderá sobre DAGs, mas também sobre Tasks e Operadores, aplicando esses conceitos em um projeto prático e envolvente. Esse projeto não só solidificará seu entendimento, mas também servirá como um excelente item de portfólio, demonstrando suas habilidades recém-adquiridas.

Ao concluir esta fase, você terá não apenas uma compreensão sólida dos pipelines de dados, mas também prática hands-on com uma das ferramentas mais demandadas do mercado. Isso te capacitará a construir seus próprios pipelines de dados de forma eficiente e inovadora.

Curso Apache Airflow: orquestrando seu primeiro pipeline de dados

08hEscola

Além dessa, a categoria Data Science conta com cursos de Ciência de dados, BI, SQL e Banco de Dados, Excel, Machine Learning, NoSQL, Estatística,e mais...

Conheça a Escola

O Plano Plus evoluiu: agora com Luri para impulsionar sua carreira com os melhores cursos e acesso à maior comunidade tech.

2 anos de Alura

Matricule-se no plano PLUS 24 e garanta:

Jornada de estudos progressiva que te guia desde os fundamentos até a atuação prática. Você acompanha sua evolução, entende os próximos passos e se aprofunda nos conteúdos com quem é referência no mercado.

Programação, Data Science, Front-end, DevOps, Mobile, Inovação & Gestão, UX & Design, Inteligência Artificial

Formações com mais de 1500 cursos atualizados e novos lançamentos semanais, em Programação, Inteligência Artificial, Front-end, UX & Design, Data Science, Mobile, DevOps e Inovação & Gestão.

A cada curso ou formação concluído, um novo certificado para turbinar seu currículo e LinkedIn.

Acesso à inteligência artificial da Alura.

No Discord, você participa de eventos exclusivos, pode tirar dúvidas em estudos colaborativos e ainda conta com mentorias em grupo com especialistas de diversas áreas.

Faça parte da maior comunidade Dev do país e crie conexões com mais de 120 mil pessoas no Discord.

Acesso ilimitado ao catálogo de Imersões da Alura para praticar conhecimentos em diferentes áreas.

Explore um universo de possibilidades na palma da sua mão. Baixe as aulas para assistir offline, onde e quando quiser.

Luri Vision chegou no Plano Pro: a IA da Alura que enxerga suas dúvidas, acelera seu aprendizado e conta também com o Alura Língua que prepara você para competir no mercado internacional.

2 anos de Alura

Todos os benefícios do PLUS 24 e mais vantagens exclusivas:

Chat, busca, exercícios abertos, revisão de aula, geração de legenda para certificado.

Envie imagens para a Luri e ela te ajuda a solucionar problemas, identificar erros, esclarecer gráficos, analisar design e muito mais.

Aprenda um novo idioma e expanda seus horizontes profissionais. Cursos de Inglês, Espanhol e Inglês para Devs, 100% focado em tecnologia.

Escolha os ebooks da Casa do Código, a editora da Alura, que apoiarão a sua jornada de aprendizado para sempre.

Para quem quer atingir seus objetivos mais rápido: Luri Vision ilimitado, vagas de emprego exclusivas e mentorias para acelerar cada etapa da jornada.

2 anos de Alura

Todos os benefícios do PRO 24 e mais vantagens exclusivas:

Catálogo de tecnologia para quem é da área de Marketing

Envie imagens para a Luri e ela te ajuda a solucionar problemas, identificar erros, esclarecer gráficos, analisar design e muito mais de forma ilimitada.

Escolha os ebooks da Casa do Código, a editora da Alura, que apoiarão a sua jornada de aprendizado para sempre.

Conecte-se ao mercado com mentoria individual personalizada, vagas exclusivas e networking estratégico que impulsionam sua carreira tech para o próximo nível.